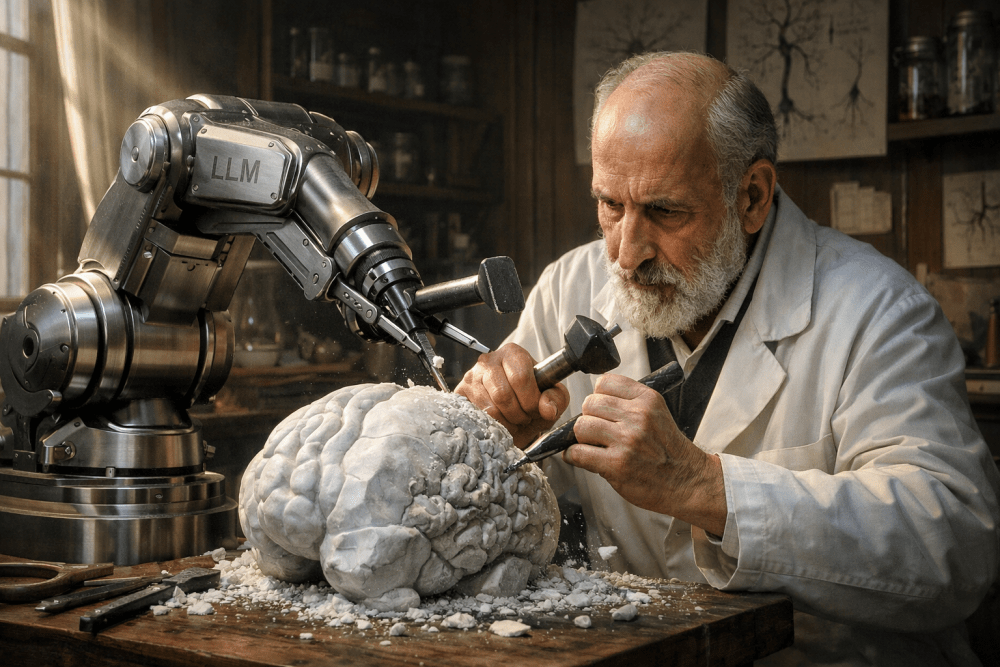

Każdy człowiek, jeśli tylko zechce, może zostać rzeźbiarzem własnego mózgu

Pojawienie się dużych modeli językowych (LLM) w codziennej pracy cichaczem, choć dogłębnie, zmienia sposób, w jaki myślimy, uczymy się i podejmujemy decyzje. Ich efekt jest szczególnie widoczny w inżynierii oprogramowania: po raz pierwszy mamy narzędzia, które nie tylko automatycznie uzupełniają nazwy zmiennych i metod, ale także proponują architektury, piszą testy, tłumaczą na wiele języków programowania i sugerują rozwiązania z płynnością, która konkuruje z ludzkimi zdolnościami.

Dowody empiryczne dotyczące produktywności, choć wciąż się nie dają całościowego obrazu, już wskazują na wymierną poprawę w przypadku konkretnych zadań. W kontrolowanym eksperymencie z wykorzystaniem GitHub Copilot grupa programistów ukończyła zadanie wdrożenia znacznie szybciej niż grupa kontrolna [1]. Jednocześnie zaobserwowano wzrost wydajności i pewną zbieżność jakości profesjonalnego tworzenia kodu, gdy wprowadzono asystenta podobnego do ChatGPT [2]. Poza tymi wynikami szczególnie uderzające są wypowiedzi liderów branży: Gustav Söderström (współzarządzający Spotify) stwierdził niedawno podczas prezentacji wyników Spotify za czwarty kwartał 2025 r., że jego programiści „nie napisali ani jednego wiersza kodu od grudnia”, a jedynie naprowadzają narzędzia do generowania kodu [3]. Boris Cherny, szef Claude Code, stwierdził również, że „100% jego kodu w ciągu ostatnich dwóch miesięcy opracował wyłącznie Opus 4.5” [4]. Nawet Sam Altman zasugerował, że GPT-5 Codex był aktywnym elementem swojego rozwoju, programując sam siebie [5].

Ta zmiana paradygmatu współistnieje jednak z niewygodnym pytaniem, które stanowi motywację tego trzeciego postu z serii na temat LLM: Co dzieje się z umiejętnościami, których nie ćwiczymy, gdy „delegujemy” część poznawczych wysiłków?

W edukacji debatę spolaryzowało wskazanie problemu: plagiat a nowe możliwości. W badaniach opisano, w jaki sposób powszechny dostęp do narzędzi generatywnych może zmienić zachowania (a czasem postrzeganie) w zakresie uczciwości akademickiej. W szczególności opublikowano analizy obejmujące dane sprzed popularyzacji ChataGPT i po niej, które mają na celu przeanalizowanie stabilności lub zmiany wzorców w dziedzinie kopiowania oraz ponownego wykorzystywania pracy innych osób w szkołach średnich [6]. Nie tylko w szkolnictwie istnieje obawa o to, w jaki sposób narzędzia te rekonfigurują nawyki: jeśli wygenerowany tekst jest wystarczająco poprawny, to pokusa, aby go nie edytować i nie zmieniać pod kątem własnego sposobu myślenia, staje się realna.

Należy tu dokonać rozróżnienia: używanie LLM jako kalkulatora („outsourcing” mechanicznych obliczeń) nie jest tym samym, co stosowanie go jako zamiennika rozumowania („outsourcing” konstruowania modelu umysłowego). Najnowsze piśmiennictwo zaczyna wskazywać zagrożenia zgodne z tym, co podpowiada nam intuicja: obserwuje się powiązania między poważnym uzależnieniem od sztucznej inteligencji a obniżeniem poziomu krytycznego myślenia, prawdopodobnie mamy tu do czynienia z różnymi mechanizmami, takimi jak zmęczenie poznawcze, przy czym za swego rodzaju okoliczność łagodzącą można by uznać demokratyzację dostępu do informacji [7]. Ponadto w przypadku zadań polegających na uczeniu się, w których stosowanie LLM porównywano ze stosowaniem tradycyjnej wyszukiwarki, odnotowano zmniejszenie wysiłku umysłowego oraz ograniczenie głębokości rozumowania, co sugeruje, że „łatwość” może wiązać się z obniżeniem skuteczności uczenia się, o ile nie kompensują jej aktywne strategie [8].

W inżynierii oprogramowania tę „poznawczą atrofię” [9] można interpretować jako źle skalibrowany offloading: przenosimy na asystenta zadania, które wcześniej były kluczowe w celowym treningu umiejętności kreatywnych i analitycznych przy tworzeniu oprogramowania (identyfikacja błędu, debugowanie hipotez, projektowanie abstrakcji, wybór struktury danych), a sami pozostajemy głównie przy zadaniach ograniczonych do nadzoru i korekt. Paradoksalnie sam nadzór także wiąże się z pułapkami.

Już klasyczne badania nad automatyzacją ostrzegały, że korzystanie, niewłaściwe korzystanie i nadużywanie automatycznych systemów jest uzależnione od czynników takich jak zaufanie, obciążenie psychiczne lub postrzeganie ryzyka oraz że czynniki te mogą prowadzić zarówno do nadmiernego polegania na naszych zdolnościach umysłowych, jak i ich niedostatecznego wykorzystania [10]. We współczesnych badaniach zaobserwowano również, że sama świadomość, iż wsparcie zapewnia sztuczna inteligencja, może zwiększyć tendencję do całkowitego polegania na niej, nawet jeśli oferowane przez nią rozwiązania są sprzeczne ze znanym kontekstem informacyjnym oraz z własną oceną użytkownika [11]. W praktyce programistycznej oznacza to przyjmowanie podpowiedzi, które brzmią sensownie, ale mają ukryte wady, a rachunek za nie przychodzi później: w postaci trudnych do wychwycenia błędów, narastającego długu technicznego i – co najistotniejsze – przerwania procesu uczenia się, zanim przyniesie on trwały efekt.

W przypadku juniorów ryzyko jest dwojakie. Młodzi programiści stają w obliczu dylematu Dr JekyLLM czy Mr Hyde: Sztuczna inteligencja może stać się dźwignią edukacyjną lub też niebezpieczną pokusą, która pozbawia ich możliwości uczenia się na wczesnych błędach, gdy można im jeszcze zaradzić. Z jednej strony modele LLM mogą przyspieszać dostarczanie rozwiązań i dawać złudne poczucie kompetencji (bo kod „działa”), jednocześnie skracając czas, który wcześniej poświęcano na zrozumienie, dlaczego właściwie działa. Z drugiej strony, gdy organizacje koncentrują się wyłącznie na przepustowości, łatwo o przesunięcie akcentu w procesie nauki: z eksploracji wspieranej refleksją ku czystemu, nadzorowanemu wykonywaniu.

Wyniki badań użyteczności są bardzo pouczające: w testach z udziałem świeżo upieczonych programistów pojawiają się punkty tarcia (na przykład wątpliwości, co zaakceptować), nieporozumienia (dotyczące tego, co model AI rzeczywiście gwarantuje) oraz strategie kompensacyjne (weryfikacja po fakcie, szybkie łatanie). Dlatego nie wystarczy podawać modelowi prompty: musimy nauczyć się włączać LLM bez wyłączania myślenia [12]. Jednocześnie porównawcze zestawienia jakości wykazują coś niepokojącego: poprawność, łatwość utrzymania czy bezpieczeństwo stosowania wygenerowanego kodu nie są oczywistością: wynik może być prawidłowy, ale nieoptymalny bądź niestabilny [13].

W tym artykule argumentuję, że nie jesteśmy skazani na to, iż spełni się ten czarny scenariusz – gdyż kryje on w sobie niezwykłą szansę. Przy niewielkim wysiłku modele LLM mogą stać się ramami poznawczymi, a nie technologią zastępującą myślenie; narzędziem, które – jak powiedział Ramón y Cajal – pozwala nam „stać się rzeźbiarzami własnego mózgu” i usprawnia naukę na skalę, którą trudno było sobie wyobrazić kilkadziesiąt lat temu.

Pierwszą wskazówką (lub, jak kto woli, trikiem) jest wyraźne oddzielenie dwóch uzupełniających się trybów pracy: trybu szybkiej realizacji zadań i trybu nauki. W trybie szybkiej realizacji naszym celem jest postęp w realizacji zadań, choć przy zachowaniu ścisłej kontroli jakości (testy, analiza statyczna, weryfikacja przez innych programistów). Także w trybie uczenia naszym celem jest postęp w realizacji zadań przy zachowaniu kontroli jakości, ale bez rezygnacji z doskonalenia umiejętności: wymagamy podania alternatyw i związanych z nimi kompromisów; wyjaśnień z uwzględnieniem niezmienników oraz złożoności; przypadków granicznych i uzasadnienia, dlaczego „naiwne” rozwiązania zawiodły; albo wymuszamy „drugą rundę” – programista tworzy rozwiązanie od nowa, pomijając wynik poprzedniej rundy z modelu.

Ta zmiana podejścia jest zgodna z wynikami badań, które ostrzegają przed „metapoznawczym lenistwem”, czyli sytuacją, w której narzędzie doskonali produkt końcowy, ale może nie doskonalić przyrostu wiedzy, jeśli zabrakło samoregulacji, refleksji i osobistego wysiłku na określonym poziomie [14]. Najnowsze krytyczne analizy sztucznej inteligencji i procesu uczenia się zdają się wskazywać, że klucz leży właśnie w procesie, w którym „rzeźbimy” siebie poprzez praktykę. Skupia się on nie tyle na samym narzędziu, co na sposobie zaprojektowania zadania i procesu uczenia się: jakie procesy poznawcze aktywuje, jaki rodzaj uwagi promuje i jakie nawyki utrwala [15].

Strategie te mogą przybrać formę prostych „rytuałów”, odpowiednich pod kątem danego środowiska korporacyjnego i młodych zespołów. Oto kilka przykładów:

- Aktywne porównywanie: prosimy LLM o rozwiązanie, ale zanim je zaakceptujemy, opracowujemy własne (nawet jeśli nie będzie kompleksowe), a następnie porównujemy te rozwiązania.

- Krótka analiza post-mortem: jeśli coś poszło nie tak, opisujemy własnymi słowami, czego się nauczyliśmy (wzorzec, API, błąd koncepcyjny) i jaki sygnał pozwolił nam wykryć błąd.

- Celowe ograniczenia: wyznaczenie małych „stref bez kopilota” (katas, moduły szkoleniowe, przeglądy), w których początkujący programista ćwiczy od zera.

- Ukierunkowane prompty umożliwiające indywidualną naukę: „Nie podawaj mi ostatecznego kodu; zadawaj mi pytania, sugeruj kroki i weryfikuj moje hipotezy”.

- Weryfikacja jako nauka: przekształcenie kontroli w bardziej intensywną aktywność intelektualną (właściwości, niezmienniki, testy warunków skrajnych), a nie tylko prosty osąd „test zaliczony / test niezaliczony”.

Dzięki konsekwencji i dyscyplinie w stosowaniu tego modelu, LLM przestanie być drogą na skróty, która „wyłącza mózg”, a stanie się dźwignią naszej ciekawości i możliwości rozwoju zawodowego: intelektualnym partnerem sparingowym, który wprawdzie ma pewne ograniczenia, ale za to jest dostępny 24/7 i wymaga od programisty przejęcia odpowiedzialności za myślenie.

Ostatecznie kluczem jest celowa praktyka i ciągłe uczenie się, aby utrzymać „ostrość umysłu”, zgodnie z maksymą przypisywaną Benjaminowi Franklinowi. Częścią mojej pracy jest sprawienie, aby sztuczna inteligencja ewoluowała, była użyteczna i stosowana odpowiedzialnie w sektorach, w których poprzeczka jakości jest ustawiona bardzo wysoko. W tym artykule dzielę się tym, czego się nauczyłem, aby każdy (od tych początkujących po tych z wieloletnim doświadczeniem) miał możliwość refleksji oraz podzielnia się własnymi doświadczeniami. Jeśli ta seria postów pomogła ci spojrzeć na sztuczną inteligencję nieco spokojniej i racjonalniej w środowisku przeładowanym szumem, to spełniła swoje zadanie.

Autor(ka): David Miraut

Bibliografia:

[1] S. Peng, E. Kalliamvakou, P. Cihon, M. Demirer, „The Impact of AI on Developer Productivity: Evidence from GitHub Copilot”, 13.02.23, arXiv: arXiv:2302.06590. doi: 10.48550/arXiv.2302.06590.

[2] S. Noy, W. Zhang, „Experimental evidence on the productivity effects of generative artificial intelligence”, Science, tom 381, nr 6654, s. 187–192, lipiec 2023, doi: 10.1126/science.adh2586.

[3] „Spotify twierdzi, że jego programiści nie napisali «ani jednego wiersza kodu» w 2026 roku, a to wiele mówi o przyszłości”. Dostęp: 24.02.26 [online], https://www.elconfidencial.com/tecnologia/2026-02-14/programadores-spotify-no-escriben-codigo-1qrt_4302850/?utm_source=chatgpt.com.

[4] M. Zeff, „Cómo Claude Code está transformando el software, empezando por Anthropic”, WIRED. Dostęp: 24.02.26 [online], https://es.wired.com/articulos/como-claude-code-esta-transformando-el-software-empezando-por-anthropic.

[5] B. Edwards, „How OpenAI is using GPT-5 Codex to improve the AI tool itself”, Ars Technica. Dostęp: 24.02.26 [online], https://arstechnica.com/ai/2025/12/how-openai-is-using-gpt-5-codex-to-improve-the-ai-tool-itself/.

[6] V. R. Lee, D. Pope, S. Miles, R. C. Zárate, „Cheating in the age of generative AI: A high school survey study of cheating behaviors before and after the release of ChatGPT”, Comput. Educ. Artif. Intell., tom 7, s. 100253, grudzień 2024, doi: 10.1016/j.caeai.2024.100253.

[7] J. Tian, R. Zhang, „Learners’ AI dependence and critical thinking: The psychological mechanism of fatigue and the social buffering role of AI literacy”, Acta Psychol. (Amst.), tom 260, s. 105725, październik 2025, doi: 10.1016/j.actpsy.2025.105725.

[8] M. Stadler, M. Bannert, M. Sailer, „Cognitive ease at a cost: LLMs reduce mental effort but compromise depth in student scientific inquiry”, Comput. Hum. Behav., tom 160, s. 108386, listopad 2024, doi: 10.1016/j.chb.2024.108386.

[9] N. Kosmyna et al., „Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task”, 31.12.25, arXiv: arXiv:2506.08872. doi: 10.48550/arXiv.2506.08872.

[10] R. Parasuraman, V. Riley, „Humans and Automation: Use, Misuse, Disuse, Abuse”, Hum. Factors, tom 39, nr 2, s. 230–253, czerwiec 1997, doi: 10.1518/001872097778543886.

[11] A. Klingbeil, C. Grützner, P. Schreck, „Trust and reliance on AI – An experimental study on the extent and costs of overreliance on AI”, Comput. Hum. Behav., tom 160, s. 108352, listopad 2024, doi: 10.1016/j.chb.2024.108352.

[12] P. Vaithilingam, T. Zhang, E. L. Glassman, „Expectation vs. Experience: Evaluating the Usability of Code Generation Tools Powered by Large Language Models”, w: Extended Abstracts of the 2022 CHI Conference on Human Factors in Computing Systems, w: CHI EA ’22. New York, NY, USA: Association for Computing Machinery, kwiecień 2022, s. 1–7. doi: 10.1145/3491101.3519665.

[13] B. Yetiştiren, I. Özsoy, M. Ayerdem, E. Tüzün, „Evaluating the Code Quality of AI-Assisted Code Generation Tools: An Empirical Study on GitHub Copilot, Amazon CodeWhisperer, and ChatGPT”, 22.10.23, arXiv: arXiv:2304.10778. doi: 10.48550/arXiv.2304.10778.

[14] Y. Fan et al., „Beware of metacognitive laziness: Effects of generative artificial intelligence on learning motivation, processes, and performance”, Br. J. Educ. Technol., tom 56, nr 2, s. 489–530, 2025, doi: 10.1111/bjet.13544.

[15] E. Bauer, S. Greiff, A. C. Graesser, K. Scheiter, M. Sailer, „Looking Beyond the Hype: Understanding the Effects of AI on Learning”, Educ. Psychol. Rev., tom 37, nr 2, s. 45, kwiecień 2025, doi: 10.1007/s10648-025-10020-8.