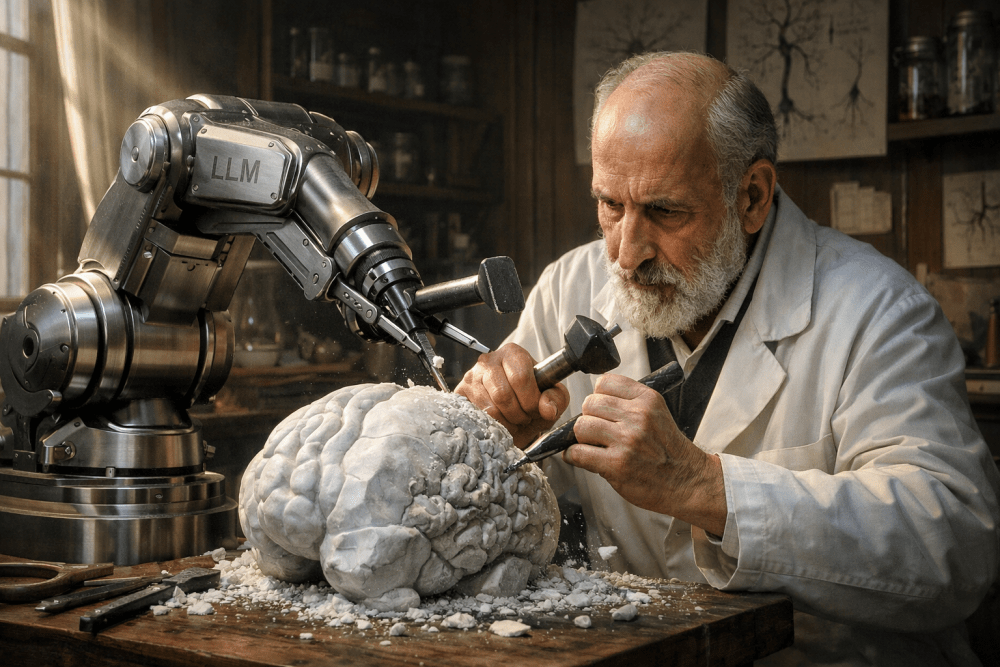

Tota persona pot ser, si s’ho proposa, escultora del seu propi cervell

La irrupció dels grans models de llenguatge (LLM) en el treball diari està alterant, de manera silenciosa però profunda, la manera en què pensem, aprenem i prenem decisions. En enginyeria del programari, el seu efecte és especialment visible: per primera vegada disposem d’eines que no només autoemplenen noms de variables i mètodes, sinó que proposen arquitectures, redacten proves, tradueixen entre llenguatges de programació i suggereixen solucions amb una fluïdesa que competeix amb la perícia humana.

L’evidència empírica sobre productivitat, tot i que encara és incipient, ja apunta a millores mesurables en tasques concretes. En un experiment controlat amb GitHub Copilot, un grup de desenvolupadors va completar una tasca d’implementació significativament més ràpid que el grup de control.[1] En paral·lel, en escriptura professional s’han observat increments de productivitat i certa convergència de qualitat quan s’introdueix un assistent tipus ChatGPT.[2] A aquests resultats se sumen declaracions especialment cridaneres de líders del sector: Gustav Söderström (coCEO de Spotify) va afirmar recentment, en la presentació de resultats del 4T del 2025, que els seus desenvolupadors «no han escrit ni una sola línia de codi des del desembre», sinó que es limiten a guiar eines de generació.[3] Boris Cherny, responsable de Claude Code, va afirmar igualment que «el 100% del seu codi els últims dos mesos ha estat escrit íntegrament per Opus 4.5».[4] Fins i tot Sam Altman ha suggerit que GPT-5 Codex ha estat part activa del seu propi desenvolupament, ja que s’ha programat a si mateix.[5]

Aquest canvi de paradigma, però, conviu amb una pregunta incòmoda, que motiva el tercer apunt de la sèrie sobre LLM: Què passa amb les habilitats que deixem d’exercir quan «deleguem» part de l’esforç cognitiu?

En educació, el debat s’ha polaritzat entre el frau i l’oportunitat. Hi ha estudis que descriuen com l’accés generalitzat a eines generatives pot modificar conductes (i, de vegades, percepcions) entorn de la integritat acadèmica; en particular, s’han publicat anàlisis amb dades prèvies i posteriors a la popularització de ChatGPT que exploren l’estabilitat o el canvi de patrons de còpia i reutilització de treballs aliens a secundària.[6] Més enllà de l’aula, preocupa la manera en què aquestes eines reconfiguren hàbits: si un text «es produeix» amb suficient correcció, la temptació de no revisar ni integrar el contingut en el propi marc mental és real.

En aquest punt convé introduir una distinció: no és el mateix usar un LLM com a calculadora (per externalitzar un càlcul mecànic) que usar-lo com a substitut del raonament (per externalitzar la construcció del model mental). La literatura recent comença a assenyalar riscos compatibles amb aquesta intuïció: s’han observat associacions entre més dependència de la IA i nivells més baixos de pensament crític, amb mecanismes plausibles (com la fatiga cognitiva) i amb el paper amortidor, encara que imperfecte, de l’alfabetització informacional.[7] A més, en tasques d’aprenentatge en què es compara l’ús d’un LLM amb un cercador tradicional, s’ha reportat una reducció de l’esforç mental, juntament amb una reducció en la profunditat del raonament, la qual cosa suggereix que la «facilitat» pot tenir un cost en l’aprenentatge si no es compensa amb estratègies actives.[8]

En enginyeria del programari, aquesta «atròfia cognitiva»[9] es pot interpretar com un offloading mal calibrat: traslladem a l’assistent passos que abans eren clau en l’entrenament deliberat d’habilitats creatives i analítiques en desenvolupament del programari (llegir un error, depurar hipòtesis, dissenyar una abstracció, triar una estructura de dades) i ens quedem, sobretot, amb tasques de supervisió i correcció. Paradoxalment, aquesta supervisió tampoc és trivial.

La recerca clàssica sobre automatització ja advertia que l’ús, el mal ús i l’abús de sistemes automàtics depèn de factors com la confiança, la càrrega mental o la percepció del risc, i que aquests factors poden empènyer tant la dependència excessiva com la infrautilització de les nostres capacitats mentals.[10] En el terreny experimental contemporani, també s’ha observat que la mera consciència que un consell provingui d’una IA pot incrementar la tendència a seguir-lo fins i tot quan contradiu informació contextual disponible i el mateix judici de l’usuari.[11] Traslladat al codi, això es tradueix a acceptar suggeriments plausibles, però defectuosos, amb un cost diferit: fallades subtils, deute tècnic i, sobretot, aprenentatge que no arriba a cristal·litzar, perquè el raonament s’interromp abans de consolidar-se.

Per a perfils júnior el risc és doble. Els enginyers joves es troben davant la dicotomia del Dr. JekyLLM i Mr. Hyde: la IA pot esdevenir una palanca d’aprenentatge o una temptació perillosa que els roba l’oportunitat d’aprendre dels errors inicials quan encara es poden gestionar. D’una banda, els LLM poden accelerar el lliurament i donar una falsa sensació de competència (en escriure codi amb el qual el sistema «funciona») i reduir el temps que abans s’invertia a entendre per què funciona. D’altra banda, si les organitzacions prioritzen únicament el throughput, és fàcil desplaçar l’entrenament des de l’exploració guiada cap a la mera execució supervisada.

Els estudis d’usabilitat són molt reveladors: en proves amb enginyers titulats recentment apareixen friccions (per exemple, dubtes sobre què acceptar), malentesos (sobre el que el model d’IA realment garanteix) i estratègies de compensació (revisió a posteriori, esmenes ràpides). Per això, no n’hi ha prou amb escriure prompts: cal aprendre a incorporar els LLM sense substituir el raonament.[12] I, en paral·lel, les comparatives de qualitat adverteixen que la correcció, la mantenibilitat o la seguretat del codi generat no són uniformes: la sortida pot ser vàlida i, tot i així, subòptima o fràgil.[13]

En aquest article vull defensar que aquest escenari no és inevitable: amaga una oportunitat extraordinària. Amb un esforç modest, el mateix LLM es pot convertir en una tecnologia d’andamiatge cognitiu, més que de substitució; una eina que, en paraules de Ramón y Cajal, ens permeti «convertir-nos en escultors del nostre propi cervell» i potenciï l’aprenentatge a una escala difícil d’imaginar dècades enrere.

El primer consell (o truc) consisteix a separar explícitament dues formes de treball complementàries: el mode lliurament ràpid i el mode aprenentatge. En el mode lliurament, l’objectiu és avançar, però amb controls de qualitat estrictes (proves, anàlisi estàtica, revisió per parells). En el mode aprenentatge, l’objectiu és també avançar amb aquests controls, però sense renunciar a enfortir el model mental: demanar alternatives i els seus compromisos; exigir explicacions amb invariants i complexitat; sol·licitar que l’assistent derivi casos límit i justifiqui per què es trenquen solucions «ingènues»; o forçar una «segona volta» en la qual el mateix enginyer reescriu la solució sense mirar el resultat previ.

Aquesta reblada de clau és consistent amb els resultats de recerques que adverteixen sobre la «mandra metacognitiva»: quan l’eina millora el producte final, pot no millorar el guany de coneixement si no s’indueix autoregulació, reflexió i cert nivell d’esforç personal.[14] En la línia de revisions crítiques recents sobre IA i aprenentatge, sembla que la clau està precisament en aquest procés en el qual ens esculpim a nosaltres mateixos amb la pràctica: centrant menys l’atenció en l’eina en si i més en com es dissenya la tasca i el procés d’aprenentatge; quins processos cognitius activa, quina mena d’atenció promou i quins hàbits consolida.[15]

Aquestes estratègies es poden materialitzar en rituals senzills, compatibles amb un entorn corporatiu i equips amb membres joves. Per exemple:

- Comparació activa: demanar a l’LLM una solució i, abans d’acceptar-la, escriure’n una pròpia (encara que sigui parcial) i després comparar-les.

- Anàlisi post-mortem breu: prendre notes amb les nostres pròpies paraules sobre què s’ha après (un patró, una API, un error conceptual) i quin senyal t’ha permès detectar un error.

- Restriccions deliberades: reservar petites «zones sense copilot» (kates, mòduls de formació, revisions) en què el perfil júnior practiqui des de zero.

- Prompts orientats de tutoria personalitzada: «No em donis el codi final; fes-me preguntes, suggereix passos i valida les meves hipòtesis».

- Verificació com a aprenentatge: convertir la revisió en una activitat intel·lectual més intensa (propietats, invariants, proves d’estrès), no en un simple «passa o no passa el test».

Si es manté aquesta disciplina, l’LLM deixa de ser una drecera que ens «apaga el cervell» i passa a ser un multiplicador de la nostra curiositat i les nostres possibilitats de creixement professional: un sparring intel·lectual amb certes limitacions, però disponible 24/7, que exigeix que l’enginyer sostingui la responsabilitat del raonament.

En darrer terme, la clau rau en la pràctica deliberada i l’aprenentatge continu per mantenir les capacitats «afilades», en la línia de la màxima atribuïda a Benjamin Franklin. Part de la meva feina és que la IA evolucioni, sigui útil i responsable en sectors en què el llistó de qualitat és molt alt. En aquest article comparteixo el que he après perquè qualsevol (des de qui està començant fins a qui té dècades d’experiència) pugui reflexionar i compartir la seva experiència. Si aquesta sèrie d’apunts t’ha ajudat a mirar la IA amb una mica més de calma en un entorn sobrecarregat de hype, ja ha complert la seva funció.

Autor: David Miraut

Referències:

[1] S. Peng, E. Kalliamvakou, P. Cihon i M. Demirer, «The Impact of AI on Developer Productivity: Evidence from GitHub Copilot», 13 feb. 2023, arXiv: arXiv:2302.06590. doi: 10.48550/arXiv.2302.06590.

[2] S. Noy i W. Zhang, «Experimental evidence on the productivity effects of generative artificial intelligence», Science, vol. 381, núm. 6654, pàg. 187-192, jul. 2023, doi: 10.1126/science.adh2586.

[3] «Spotify asegura que sus programadores no han escrito “ni una sola línea de código” en 2026 y eso dice mucho del futuro que nos aguarda». Accés: 24 feb. 2026. [En línia]. Disponible a: https://www.elconfidencial.com/tecnologia/2026-02-14/programadores-spotify-no-escriben-codigo-1qrt_4302850/?utm_source=chatgpt.com

[4] M. Zeff, «Cómo Claude Code está transformando el software, empezando por Anthropic», WIRED. Accés: 24 feb. 2026. [En línia]. Disponible a: https://es.wired.com/articulos/como-claude-code-esta-transformando-el-software-empezando-per-anthropic

[5] B. Edwards, «How OpenAI is using GPT-5 Codex to improve the AI tool itself», Ars Technica. Accés: 24 feb. 2026. [En línia]. Disponible a: https://arstechnica.com/ai/2025/12/how-openai-is-using-gpt-5-codex-to-improve-the-ai-tool-itself/

[6] V. R. Lee, D. Pope, S. Miles i R. C. Zárate, «Cheating in the age of generative AI: A high school survey study of cheating behaviors before and after the release of ChatGPT», Comput. Educ. Artif. Intell., vol. 7, p. 100253, des. 2024, doi: 10.1016/j.caeai.2024.100253.

[7] J. Tian i R. Zhang, «Learners. AI dependence and critical thinking: The psychological mechanism of fatigue and the social buffering role of AI literacy», Acta Psychol. (Amst.), vol. 260, p. 105725, oct. 2025, doi: 10.1016/j.actpsy.2025.105725.

[8] M. Stadler, M. Bannert i M. Sailer, «Cognitive ease at a cost: LLMs reduce mental effort but compromise depth in student scientific inquiry», Comput. Hum. Behav., vol. 160, p. 108386, nov. 2024, doi: 10.1016/j.chb.2024.108386.

[9] N. Kosmyna et al., «Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task», des. 31, 2025, arXiv: arXiv:2506.08872. doi: 10.48550/arXiv.2506.08872.

[10] R. Parasuraman i V. Riley, «Humans and Automation: Use, Misuse, Disuse, Abuse», Hum. Factors, vol. 39, núm. 2, pp. 230-253, juny 1997, doi: 10.1518/001872097778543886.

[11] A. Klingbeil, C. Grützner i P. Schreck, «Trust and reliance on AI — An experimental study on the extent and costs of overreliance on AI», Comput. Hum. Behav., vol. 160, p. 108352, nov. 2024, doi: 10.1016/j.chb.2024.108352.

[12] P. Vaithilingam, T. Zhang i E. L. Glassman, «Expectation vs. Experience: Evaluating the Usability of Code Generation Tools Powered by Large Language Models», a Extended Abstracts of the 2022 CHI Conference on Human Factors in Computing Systems, a CHI EA ’22. Nova York, NY, EUA: Association for Computing Machinery, abr. 2022, pàg. 1-7. doi: 10.1145/3491101,3519665.

[13] B. Yetiştiren, I. Özsoy, M. Ayerdem i E. Tüzün, «Evaluating the Code Quality of AI-Assisted Code Generation Tools: An Empirical Study on GitHub Copilot, Amazon CodeWhisperer, and ChatGPT», oct. 22, 2023, arXiv: arXiv:2304.10778. doi: 10.48550/arXiv.2304.10778.

[14] Y.Fan et al., «Beware of metacognitive laziness: Effects of generative artificial intelligence on learning motivation, processes, and performance», Br. J. Educ. Technol., vol. 56, núm. 2, p. 489-30, 2025, doi: 10.1111/bjet.13544.

[15] E. Bauer, S. Greiff, A. C. Graesser, K. Scheiter i M. Sailer, «Looking Beyond the Hype: Understanding the Effects of AI on Learning», Educ. Psychol. Rev., vol. 37, núm. 2, p. 45, abr. 2025, doi: 10.1007/s10648-025-10020-8.